이미지 확대보기

이미지 확대보기AI 능력은 GPU와 HBM 사이의 데이터 전송 속도에서 판가름 난다. 현재 ‘챗GPT’에서 일반 인공지능(AGI) 시대로 가려면 이 능력을 1000배 정도 더 늘려야 한다는 게 업계의 정설이다.

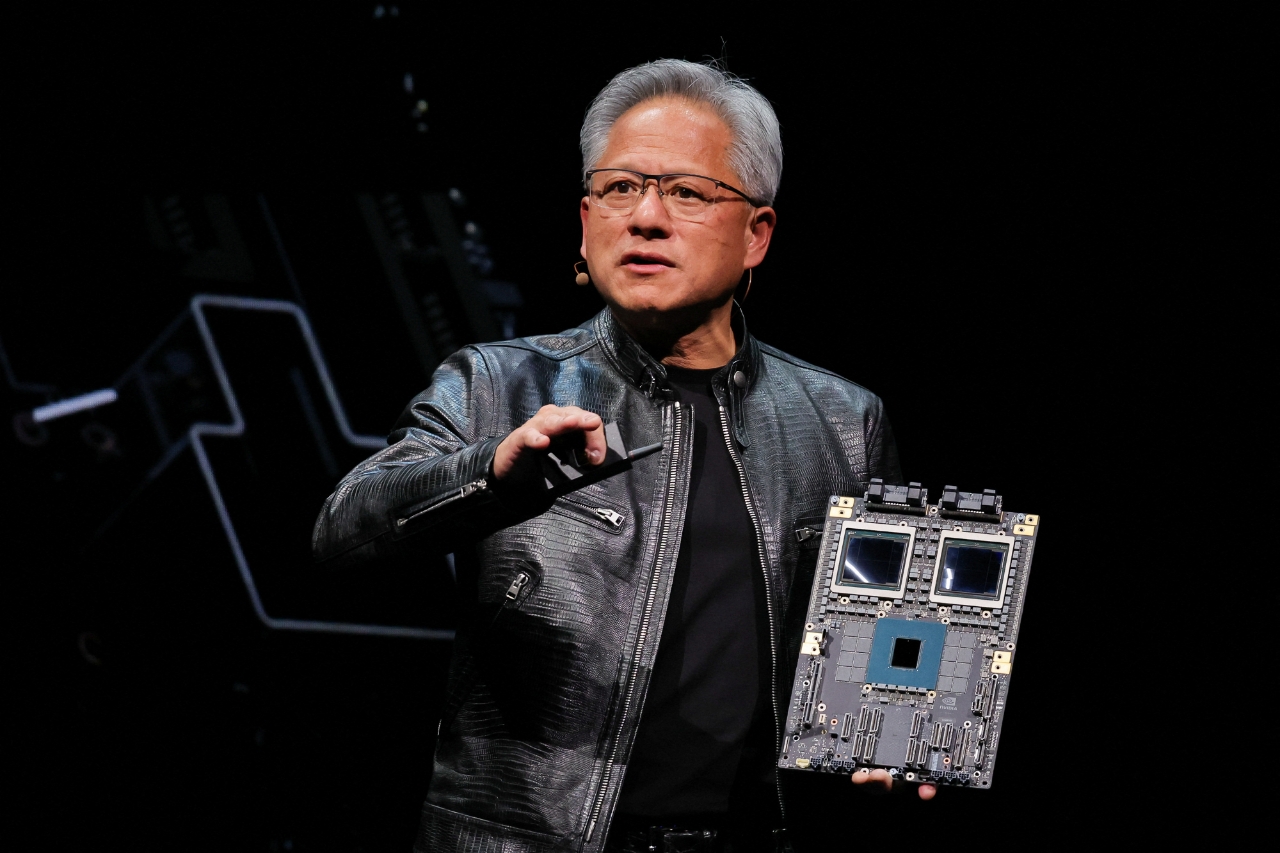

AI 반도체 대표 주자인 엔비디아와 AMD가 타이베이 ‘컴퓨텍스 2024’에서 신제품 개발 뉴스를 쏟아낸 이유다.

엔비디아의 젠슨 황 CEO가 신제품 출시 계획과 함께 차세대 AI용 GPU인 '루빈'을 최초로 공개하자 경쟁사인 AMD도 첨단 가속기 '인스팅트 MI325X'를 연내 출시한다고 응수했다.

첨단 데이터센터에서 노트북까지 사용 가능한 차세대 프로세서다. 엔비디아는 ‘블랙웰 GPU’를 이미 생산 중이다. 내년 블랙웰 울트라 출시를 통해 무어의 법칙도 깨겠다고 선언한 상태다. 루빈 GPU에는 HBM4 메모리를 채택하기로 했다.

엔비디아 블랙웰에 들어간 반도체 이름은 GB200이다.

내년에 100만 개 정도 만들어 첨단 GPU 시장의 40~50%를 점유할 수 있다는 게 젠슨 황의 구상이다. 8년 만에 컴퓨팅 성능을 1000배 늘리는 기술적 도전을 이어가고 있는 셈이다.

특히 블랙웰에서 루빈으로 전환한 기간도 3개월에 불과하다. 한마디로 AI 칩 시장의 치열한 경쟁에서 선두 자리를 유지하기 위한 엔비디아의 초격차 전략인 셈이다.

이 반도체를 어디서 생산하느냐가 우리의 관심사다. 삼성전자는 메모리 반도체 생산과 파운드리(수탁 생산) 모두 가능하다.

HBM에서 앞선 SK하이닉스는 파운드리가 없다. TSMC에 위탁 생산해야 한다. 엔비디아로서는 SK하이닉스와 TSMC 간 3각 협력을 해야 하는 상황이다. 문제는 HBM 기술이 메모리와 시스템 반도체의 경계를 무너뜨릴 수도 있다는 점이다.

메모리 강국 지위도 흔들릴 수 있다. 우리나라도 정부와 기업 간 긴밀한 협력이 필요하다.

![[초점] 스텔란티스, 트럼프 고율 관세에 美 자동차 부품공장 5곳...](https://nimage.g-enews.com/phpwas/restmb_setimgmake.php?w=80&h=60&m=1&simg=20250404155804082389a1f3094311109215171.jpg)